Man kann Regelvorgänge nicht im Detail verstehen, wenn nicht klar ist, was Information bedeutet. Die Verständigung zwischen Individuen (oder Funktionselementen) bezeichnet man als Kommunikation (Informationsweitergabe). Kommunikation beruht auf einer Übermittlung von Nachrichten, deren Bestandteile Zeichen sind. Jedes Zeichen ist ein Zeichen für etwas oder ein Zeichen von etwas. Eine Information ist demnach als eine Summe von Zeichen zu verstehen. Information als solche ist weder materiell noch energetisch verständlich.

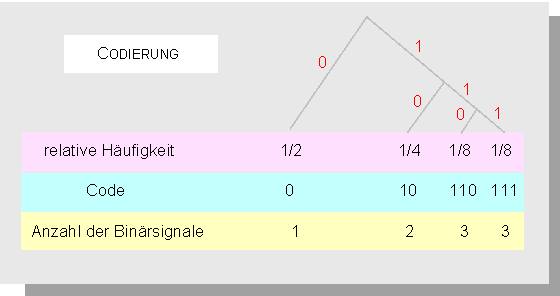

Die Zuordnung einer Information zu einem bestimmten physikalischen Zustand heißt Codierung. Jedes Zeichen ist Träger einer Bedeutung und ist damit ein Teil eines Signals. Bei einem Alphabet sind die Buchstaben die Zeichen.

Code: In der Informationstheorie unterscheidet man zwischen

Sprachen, die in historischen Zeiträumen gewachsen sind und

sich verändern, und Codes, die zu speziellen Zwecken entwickelt

wurden. Rein formal ist aber auch die Sprache ein Code. Der bekannteste

natürliche Code (im Sinne der Informationstheorie eine Sprache)

ist der genetische Code. Die genetische

Information (gespeichert in der DNS; mit einem Zeichenvorrat von

vier Nukleotiden) wird zur Bildung von Proteinen (Zeichenvorrat

20 Aminosäuren) genutzt.

Code und Signal: Zur Darstellung eines Codes werden Regeln benötigt. Nur "erlaubte" Zeichenzusammenstellungen, die vom Empfänger verstanden werden (gemeinsame Zeichenvorräte), bilden ein "Signal". Die Bildung eines vielzelligen Organismus setzt eine Kommunikation der Zellen untereinander voraus. Im simpelsten Fall produziert eine Zelle eine Substanz, einen Effektor (Elicitor) (z.B. einen Wachstumsregulator, ein Phytohormon, die von der Zelle (dem Sender) ausgeschieden und von einer anderen Zelle (dem Empfänger) erkannt oder aufgenommen wird und diese zu einer bestimmten Reaktion (z.B. verstärktem oder verzögertem Wachstum) induziert. Die Erkennung eines solchen Signals setzt im Empfänger die Existenz spezifischer, selektiver Rezeptoren voraus, die das Signalmolekül binden, Moleküle anderer Art aber nicht erkennen.

Übertragung einer Information (Nachricht): Der Weg zwischen Sender und Empfänger wird als Kanal bezeichnet, die Beziehungen zwischen Nachricht und Signal als Nachrichtenübertragung. Unterwegs können zahlreiche Fehler auftreten; Informationen können dabei verlorengehen oder verfälscht werden (Rauschen).

Quantitative Verrechnung von Informationen: Informationen werden in bit gemessen. Sind zwei Ereignisse Pl und P2 mit gleicher Wahrscheinlichkeit des Auftretens gegeben, so entspricht das genaue Wissen um das Auftreten eines dieser Ereignisse 1 bit. Bei gegebener Menge von Ereignissen A = (1, 2, 3, 4...) mit gleicher Wahrscheinlichkeit des Auftretens bedeutet das Wissen, daß eines von diesen Ereignissen auftritt, 3 bit Information. Anders ausgedrückt:

I = 2log 8 = 3 bit

log zur Basis 2 wird oft auch als ld (logarithmus dualis) bezeichnet, dann wäre

I = ld 8 = 3 bit

n bits bedeutet Auswahl aus n Alternativen.

Eine nähere Betrachtung zeigt, daß es einen Zusammenhang zwischen einem Ereignis und der Wahrscheinlichkeit seines Auftretens gibt. Je größer die Wahrscheinlichkeit eines Ereignisses ist, desto geringer ist sein Informationswert. Die Information eines Ereignisses x; ist daher der ld des Kehrwerts der Wahrscheinlichkeit seines Auftretens

I(xj) = ld l/p xi

Der mittlere Informationsgehalt einer Menge von n Ereignissen xi (i = 1,2,..n) mit den Wahrscheinlichkeiten p(xi) ist der Erwartungswert (gewogener Mittelwert) der Information der einzelnen Ereignisse (H), definiert als

H = Summe (n bis i) p (xi) ld l/p (xi)

Als einen Informationsgewinn bezeichnet man die positive Differenz eines mittleren Informationsgehalts zu einem Zeitpunkt t1 minus dem mittleren Informationsgehalt zum Zeitpunkt t2

Redundanz (=Wiederholung) ist überschüssige Information. Sie hängt davon ab, wie wahrscheinlich eine Information oder ein Zeichen ist. Es besteht somit ein direkter Zusammenhang zwischen ihr und der Information. Redundanz dient der Absicherung gegen Übertragungsfehler (Störungen). Gerade aus der Genetik können zahlreiche Beispiele angeführt werden:

Körperzellen höherer Organismen sind in der Regel diploid. Ein defektes Allel (a) kann durch gleichzeitige Anwesenheit des homologen (intakten) Partners (A) kompensiert werden.

Mikroorganismen sind meist haploid. Fehler werden durch große Individuenzahlen wettgemacht. Eine derartige Vermehrungsstrategie (Generationsdauer in der Größenordnung Minuten) kommt für Vielzeller nicht in Frage. Sowohl deren lange Generationsdauer (Wochen, Monate, Jahre) als auch der hohe Energieeinsatz zum Aufbau und zur Aufrechterhaltung der Funktionen des Organismus, stehen einer solchen Strategie im Wege. Im Verlauf der Evolution haben sich daher Mechanismen entwickelt, genetische Information zu konservieren und Fehler bei ihrer Vervielfachung zu eliminieren.

Redundanz auf der Ebene des genetischen Codes: Ein beträchtlicher Teil der Punktmutanten kommt überhaupt nicht zur Wirkung. Es gibt zahlreiche, energieverbrauchende Reparaturmechanismen, um Fehler beim Ablesen oder der Verdopplung genetischer Information zu beheben.

Ein Zuviel an Redundanz ist aber auch nicht immer förderlich. Polyploidie ist bei gewissen Pflanzen häufig. Die Wahrscheinlichkeit, daß sich unter ihnen eine neue Kombination durchsetzt, ist damit stark reduziert. Oder anders ausgedrückt, ihr Evolutionspotential ist im Vergleich zu den Diploiden relativ gering.

Redundanz finden wir auch bei der Ausbildung pflanzlicher Organe. In den meisten Fällen braucht eine Pflanze gar nicht so viele Blätter und eine derart hohe Produktionsrate an Assimilaten, um (mit Nährstoffen reichlich ausgestattete) Samen in ausreichender Zahl zu bilden.

Diese wenigen Beispiele sollen zeigen, wie vielfältig die Aspekte der Regulation sind. Bei allen physiologischen Vorgängen stellt sich daher immer wieder die Frage nach den Regulationsmechanismen. Die Kybernetik bietet ein Raster, in dem Beobachtungen und experimentell ermittelte Daten einen Platz finden. Mit steigender Zahl der Ergebnisse nimmt die Komplexität des Bildes zu. Wir - gemeint sind damit alle Naturwissenschaftler - werden daher immer nur Teilsysteme analysieren, auswerten und überblicken können.

|

|